Trainieren von tiefen neuronalen Netzen

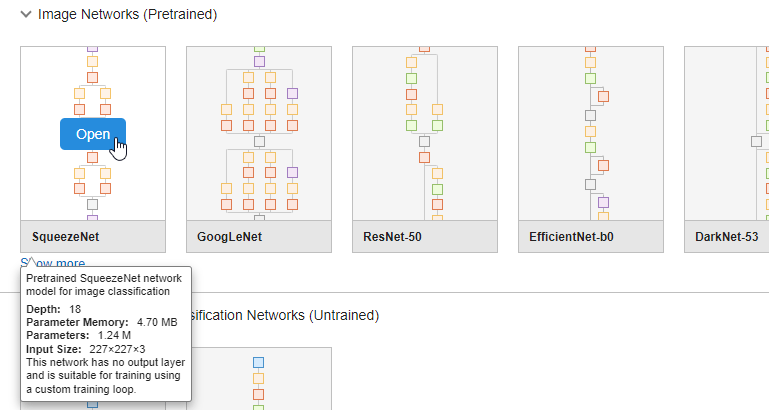

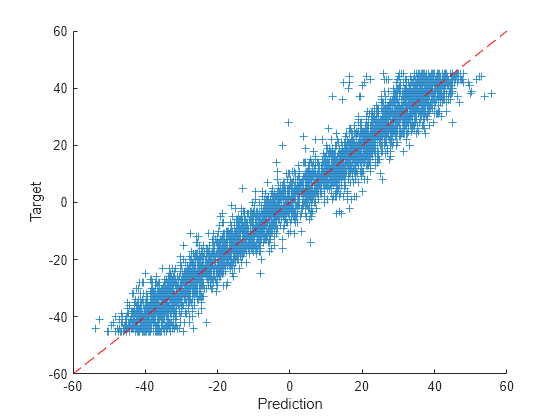

Nachdem Sie die Netzarchitektur definiert haben, können Sie die Trainingsparameter mit der Funktion trainingOptions festlegen. Sie können das Netz dann mit der Funktion trainnet trainieren. Verwenden Sie das trainierte Netz, um Klassenbezeichnungen oder numerische Antworten vorherzusagen.

Sie können ein neuronales Netz auf einer CPU, einer Grafikkarte, mehreren CPUs oder Grafikkarten oder parallel auf einem Cluster oder in der Cloud trainieren. Das Training auf einer Grafikkarte und das parallele Training erfordern die Parallel Computing Toolbox™. Bei der Verwendung einer Grafikkarte ist eine unterstützte Grafikkarte erforderlich (Informationen zu unterstützten Geräten finden Sie unter GPU Computing Requirements (Parallel Computing Toolbox)). Geben Sie die Ausführungsumgebung mit der trainingOptions-Funktion an.

Wenn die trainingOptions-Funktion nicht die Trainingsoptionen bietet, die Sie für Ihre Aufgabe benötigen, oder die benutzerdefinierten Ausgabeschichten die benötigten Verlustfunktionen nicht unterstützen, können Sie eine benutzerdefinierte Trainingsschleife definieren. Für Modelle, die nicht als Netz von Schichten angegeben werden können, können Sie das Modell als Funktion definieren. Weitere Informationen finden Sie unter Custom Training Loops.

Nachdem Sie einige gute Startoptionen identifiziert haben, können Sie eine erschöpfende Suche von Hyperparametern automatisieren oder eine Bayes'sche Optimierung mithilfe des Experiment Manager ausprobieren. Mit dem Experiment Manager können Sie verschiedene Trainingskonfigurationen gleichzeitig testen, indem Sie Ihr Experiment parallel durchführen und Ihre Fortschritte mithilfe von Trainingsdiagrammen überwachen.

Kategorien

- Integriertes Training

Trainieren von Deep-Learning-Netzen mit integrierten Trainingsfunktionen

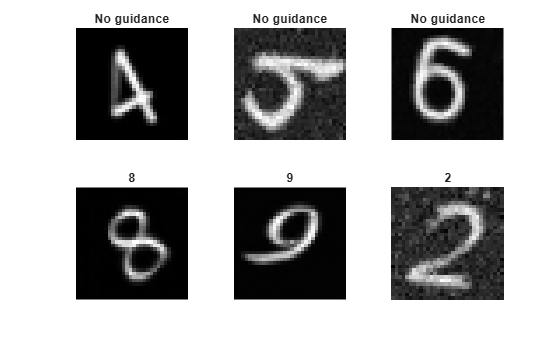

- Benutzerdefiniertes Training mit automatischer Differenzierung

Trainieren von Deep-Learning-Netzen mit benutzerdefinierten Trainingsschleifen

- Abstimmung

Programmatische Abstimmung der Trainingsoptionen, Wiederaufnahme des Trainings von einem Kontrollpunkt aus und Untersuchung von Adversarial-Beispielen

- Experimente verwalten

Trainieren von Netzen unter verschiedenen Anfangsbedingungen, interaktives Abstimmen von Trainingsoptionen und Auswerten Ihrer Ergebnisse

- Parallelverarbeitung und Cloud

Skalieren Sie Deep Learning mit mehreren Grafikkarten lokal oder in der Cloud und trainieren Sie mehrere Netze interaktiv oder in Batch-Jobs