Anpassung eines neuronalen Netzes

Lösung des Anpassungsproblems mit zweischichtigen Feed-Forward-Netzen

Beschreibung

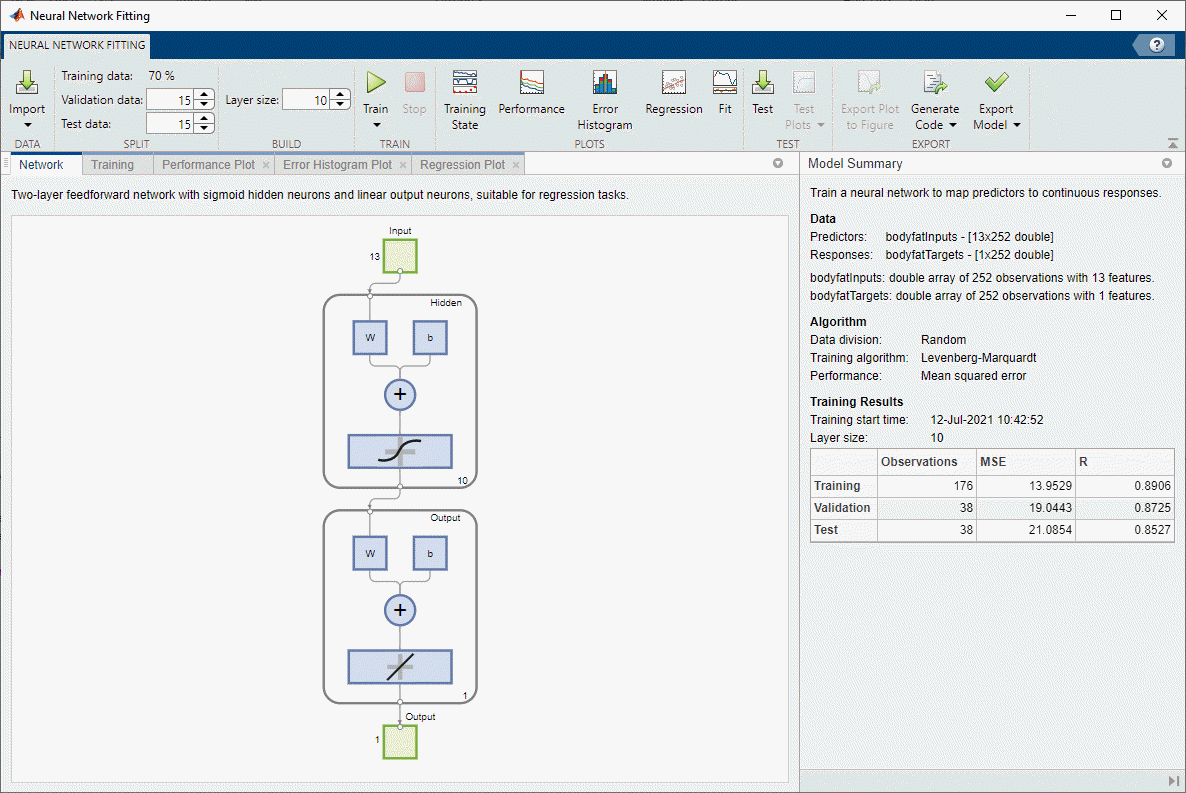

Mit der App Neural Net Fitting können Sie ein zweischichtiges Feed-Forward-Netz erstellen, visualisieren und trainieren, um Datenanpassungsprobleme zu lösen.

Mit dieser App können Sie:

Daten aus einer Datei oder dem MATLAB®-Workspace importieren oder einen der Beispieldatensätze verwenden.

Die Daten in Trainings-, Validierungs- und Testmengen unterteilen.

Ein neuronales Netz definieren und trainieren.

Die Netzleistung anhand des mittleren quadratischen Fehlers und der Regressionsanalyse bewerten.

Die Ergebnisse mit Hilfe von Visualisierungsdiagrammen, wie z. B. Regressionsanpassung oder Histogramm der Fehler analysieren.

MATLAB-Skripte erzeugen, um Ergebnisse zu reproduzieren und den Trainingsprozess anzupassen.

Funktionen generieren, die für den Einsatz mit MATLAB Compiler™ und MATLAB Coder™-Tools geeignet sind, und Sie nach Simulink® zur Verwendung mit Simulink Coder exportieren.

Tipp

Zum interaktiven Erstellen und Visualisieren neuronaler Deep-Learning-Netze verwenden Sie die App Deep Network Designer. Weitere Informationen finden Sie unter Erste Schritte mit Deep Network Designer.

Öffnen Sie die Anpassung eines neuronalen Netzes-App

MATLAB-Symbolleiste: Klicken Sie auf der Registerkarte Apps unter Machine Learning and Deep Learning auf das App-Symbol.

MATLAB-Eingabeaufforderung: Geben Sie

nftoolein.

Algorithmen

Die App Neural Net Fitting bietet integrierte Trainingsalgorithmen, mit denen Sie Ihr neuronales Netz trainieren können.

| Trainingsalgorithmus | Beschreibung |

|---|---|

| Levenberg-Marquardt | Aktualisieren Sie die Gewichtungs- und Verzerrungswerte gemäß der Levenberg-Marquardt-Optimierung. Das Levenberg-Marquardt-Training ist häufig der schnellste Trainingsalgorithmus, obwohl er mehr Speicherplatz benötigt als andere Techniken. Um diesen Algorithmus zu implementieren, verwendet die App Neural Net Fitting die Funktion |

| Bayes‘sche Regularisierung | Die Bayes'sche Regularisierung aktualisiert die Gewichtungs- und Verzerrungswerte gemäß der Levenberg-Marquardt-Optimierung. Sie minimiert dann eine Kombination aus quadrierten Fehlern und Gewichten und bestimmt die richtige Kombination, um ein gut verallgemeinerndes Netz zu erzeugen. Dieser Algorithmus nimmt in der Regel mehr Zeit in Anspruch, ist aber gut geeignet, um verrauschte oder kleine Datensätze zu verallgemeinern. Um diesen Algorithmus zu implementieren, verwendet die App Neural Net Fitting die Funktion |

| Skalierte konjugierte Gradienten-Backpropagation | Die skalierte konjugierte Gradienten-Backpropagation aktualisiert die Gewichtungs- und Verzerrungswerte nach der Methode des skalierten konjugierten Gradienten. Für große Probleme wird die skalierte konjugierte Gradienten-Backpropagation empfohlen, da sie Gradientenberechnungen verwendet, die speichereffizienter sind als die von Levenberg-Marquardt und von der Bayes'schen Regularisierung verwendeten Jacobi-Berechnungen. Um diesen Algorithmus zu implementieren, verwendet die App Neural Net Fitting die Funktion |