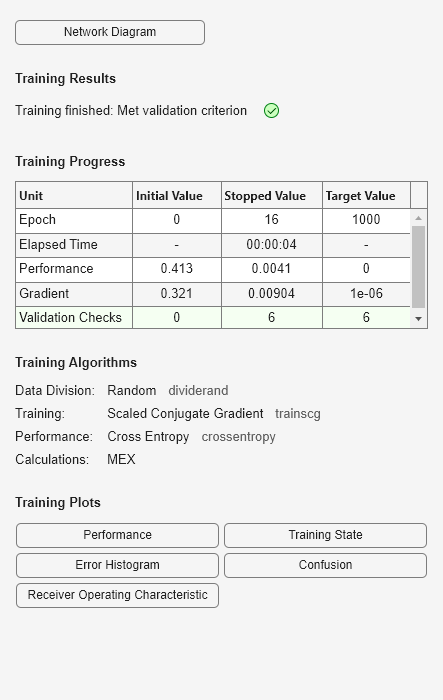

patternnet

Generieren eines Mustererkennungs-Netzes

Beschreibung

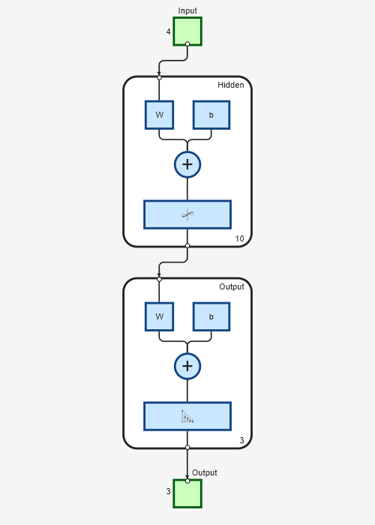

net = patternnet(hiddenSizes,trainFcn,performFcn)hiddenSizes, einer durch trainFcn festgelegten Trainingsfunktion und einer durch performFcn festgelegten Leistungsfunktion aus.

Mustererkennungs-Netze sind Feed-Forward-Netz, die darauf trainiert werden können, Eingänge nach Zielklassen zu klassifizieren. Die Zieldaten für Mustererkennungs-Netze sollten aus Vektoren mit Nullwerten bestehen, mit Ausnahme von 1 bei dem Element i, wobei i für die darzustellende Klasse steht.

Beispiele

Eingabeargumente

Ausgangsargumente

Versionsverlauf

Eingeführt in R2010b

Siehe auch

competlayer | lvqnet | network | nprtool | selforgmap